Compliance y ciberseguridad: Guía para la empresa (prevención y resiliencia)

El precio original era: 63,44 €.60,27 €El precio actual es: 60,27 €. IVA incluido

Obligaciones legales, gestión del riesgo y ciberresiliencia para proteger datos, sistemas y continuidad de negocio / Liderando la próxima generación de ciberseguridad

La obra «Compliance y ciberseguridad: Guía para la empresa» analiza la profunda transformación de la ciberseguridad en el horizonte 2026, consolidándola como un desafío estratégico, jurídico y de diseño organizativo ineludible. Bajo la exigente presión regulatoria de la Directiva NIS2, el Reglamento de Inteligencia Artificial (AI Act), DORA y el Esquema Nacional de Seguridad (ENS), el riesgo digital pasa a ser un vector de imputación directa a la alta dirección. A través de paradigmas avanzados como la Identidad Operativa, arquitecturas Zero Trust y modelos de supervisión algorítmica, este manual ofrece un marco estructural riguroso para gobernar identidades artificiales y garantizar la resiliencia corporativa.

Descripción

En la actual era de la hiperautomatización y la inteligencia artificial, la ciberseguridad ha superado definitivamente el clásico enfoque técnico-perimetral para convertirse en un pilar esencial del gobierno corporativo. El colapso de la confianza implícita y la disolución de las fronteras físicas en los sistemas de información obligan a las empresas y administraciones públicas a replantear sus arquitecturas de defensa y control bajo un escrutinio normativo sin precedentes, impulsado por regulaciones europeas críticas como la Directiva NIS2 o el Reglamento de Inteligencia Artificial.

Este tratado examina de manera sistemática y exhaustiva cómo articular jurídicamente la responsabilidad en entornos digitalizados donde interactúan agentes humanos y sistemas de inteligencia artificial autónomos. Estructurado en seis partes, desglosa desde los fundamentos normativos y la evolución del rol del responsable de seguridad (CISO), hasta las arquitecturas operativas de blindaje jurídico, pasando por la gestión de cibercrisis, el aprendizaje organizativo posfallo y la soberanía de los datos.

Como principal aportación original, la obra introduce el marco de gobernanza indispensable para controlar la autonomía algorítmica y las identidades artificiales mediante mecanismos reales como la supervisión humana significativa y los protocolos de desconexión inmediata (kill-switches). Asimismo, propone el innovador sistema de «Iconografía HMC» para radicalizar la transparencia en las decisiones automatizadas, estableciendo un puente operativo entre el cumplimiento documental clásico y la verificación técnica continua apoyada en arquitecturas Zero Trust.

Se consolida así como una herramienta de primer nivel e imprescindible para directivos, responsables de cumplimiento (compliance officers), delegados de protección de datos, directores de seguridad de la información (CISO) y asesores jurídicos. Proporciona una hoja de ruta práctica, técnica e incontestable para diseñar sistemas resilientes, proteger los activos críticos y demostrar una diligencia debida inquebrantable frente a auditorías, inspecciones y eventuales responsabilidades legales o administrativas.

Información adicional

| Subtítulo | Obligaciones legales, gestión del riesgo y ciberresiliencia para proteger datos, sistemas y continuidad de negocio / Liderando la próxima generación de ciberseguridad |

|---|---|

| Autor | Gorka Arroyuelos Gorostiza |

| Editorial | |

| Edición | 2026 |

| Páginas | 500 |

- EL AUTOR. UN ARQUITECTO DE RESILIENCIA EN LA ERA DE LA IA

- TRANSPARENCIA METODOLÓGICA Y AUTORÍA. SISTEMA DE ICONOGRAFÍA HMC (HUMAN-MACHINE COLLABORATION)

- PRÓLOGO

- PREFACIO DEL AUTOR. GOBERNAR LA TECNOLOGÍA CUANDO LA RESPONSABILIDAD NO ES DELEGABLE

- PARTE I: FUNDAMENTOS NORMATIVOS DEL NUEVO PARADIGMA

- CAPÍTULO 1: INTRODUCCIÓN Y GOBERNANZA ESTRATÉGICA DE LA CIBERSEGURIDAD

- 1.1. Políticas generales de seguridad y procedimientos

- 1.1.1. La Directiva NIS2 como obligación estructural de gobernanza del riesgo digital

- 1.1.2. El Reglamento de Inteligencia Artificial (AI Act) y la tensión regulatoria de los sistemas autónomos

- 1.1.3. El Data Act. Soberanía, interoperabilidad y acceso de terceros

- 1.2. Zero Trust como respuesta arquitectónica a la insuficiencia regulatoria y técnica

- 1.3. El marco estratégico del CISO moderno. Más allá de los controles técnicos

- 1.4. El CISO como directivo. Responsabilidad, imputación y límites en la gobernanza del riesgo digital

- 1.5. La síntesis del escudo. Hacia una arquitectura de gobernanza integrada

- 1.6. Contexto operativo

- 1.6.1. La genealogía del consenso y los principios de confiabilidad. Hacia una ontología de la IA pública

- 1.6.2. Traducción operativa. La transmutación de la norma en arquitectura de control

- 1.6.3. El CISO como traductor institucional y garante de la soberanía

- 1.6.4. La transición hacia el rigor metodológico. El diseño como respuesta a la incertidumbre

- 1.7. Marco metodológico

- 1.7.1. Enfoque epistemológico. realismo jurídico-tecnológico

- 1.7.2. Frameworks de gobernanza y arquitecturas IAM

- 1.7.3. Estrategia de investigación. El ciclo de validación de la soberanía

- Key takeaways de la Parte I

- Glosario síntesis interseccional

- Transición a Parte II

- 1.1. Políticas generales de seguridad y procedimientos

- CAPÍTULO 1: INTRODUCCIÓN Y GOBERNANZA ESTRATÉGICA DE LA CIBERSEGURIDAD

- PARTE II: LA EVOLUCIÓN DEL ROL DEL CISO Y LA EMERGENCIA DE LAS IDENTIDADES ARTIFICIALES

- CAPÍTULO 2: LA EVOLUCIÓN DEL ROL DEL CISO

- 2.1. Ciclo de vida técnico

- 2.2. El nexo de la responsabilidad

- 2.3. Emergencia de las identidades artificiales

- 2.4. Gobernanza de identidades artificiales. Imputación jurídica y responsabilidad del CISO

- 2.5. Imputación jurídica y responsabilidad administrativa en entornos con identidades artificiales

- 2.6. Identidad consciente de la privacidad (Privacy-Aware Identity)

- 2.7. Riesgos democráticos y organizativos de las identidades artificiales

- 2.8. De la identidad como acceso a la identidad como poder

- CAPÍTULO 3: IDENTIDAD DIGITAL, AGENTES DE IA Y NUEVOS MODELOS DE RESPONSABILIDAD

- 3.1. De la identidad digital clásica a la identidad operativa

- 3.1.1. Identidad, acción y poder en entornos digitales

- 3.1.2. El desbordamiento del modelo IAM tradicional

- 3.1.3. Identidades técnicas y responsabilidad difusa

- 3.1.4. Hacia una concepción ampliada de la identidad

- 3.2. El nacimiento de los agentes de IA como sujetos operativos

- 3.2.1. De la automatización clásica a la agencia algorítmica

- 3.2.2. Opacidad decisional e indefensión ante el cumplimiento

- 3.2.3. Comportamientos emergentes y el radio de explosión

- 3.2.4. La ilusión de control y la abdicación de la supervisión

- 3.2.5. De la herramienta al actor regulado

- 3.3. Identidades artificiales. Definición, tipología y riesgos

- 3.3.1. La identidad como vector de escalada de privilegios autónoma

- 3.3.2. El secuestro de la identidad artificial y la manipulación del propósito

- 3.3.3. Volatilidad y pérdida de la trazabilidad de responsabilidad

- 3.3.4. Riesgos y trazabilidad. El colapso de la confianza implícita

- 3.4. El vacío de cumplimiento. NIS2, AI Act y la crisis de la evidencia

- 3.4.1. La insuficiencia del log tradicional ante la NIS2

- 3.4.2. El mito de la supervisión humana en el AI Act

- 3.4.3. La crisis de la evidencia y la carga de la prueba

- 3.5. Gobernanza de identidades en el sector público europeo

- 3.5.1. El ENS y la identidad como arquitectura de legalidad

- 3.5.2. NIS2 y eIDAS2. La soberanía frente al riesgo sistémico

- 3.5.3. Zero Trust como modelo de integridad institucional

- 3.5.4. Gobernar identidades es gobernar legitimidad

- 3.6. Identidad consciente de la privacidad (Privacy-Aware Identity)

- 3.6.1. El poder informacional y la protección desde el diseño

- 3.6.2. Minimización, transparencia y separación de contextos

- 3.6.3. Trazabilidad proporcionada y calidad institucional

- 3.6.4. La transparencia y la trazabilidad como activos estratégicos

- 3.7. Identidad, poder y legitimidad en la administración digital

- 3.7.1. La delegación de autoridad y el control del riesgo

- 3.7.2. Contra la despersonalización. Rendición de cuentas y soberanía corporativa

- 3.7.3. Identidad, confianza y rendición de cuentas

- 3.7.4. La responsabilidad como eje de la soberanía

- 3.8. Identidad consciente de la privacidad

- 3.8.1. Fundamento conceptual y ruptura paradigmática

- 3.8.2. Arquitectura técnico-normativa de componentes

- 3.8.3. Validación mediante caso de uso técnico

- 3.8.4. Proyección de impacto y transferibilidad

- 3.8.5. Conclusiones y agenda futura

- Key takeaways de la Parte II

- Glosario síntesis interseccional

- Transición a Parte III

- 3.1. De la identidad digital clásica a la identidad operativa

- CAPÍTULO 2: LA EVOLUCIÓN DEL ROL DEL CISO

- PARTE III: ARQUITECTURAS OPERATIVAS, BLINDAJE JURÍDICO-INSTITUCIONAL Y SOBERANÍA DIGITAL

- CAPÍTULO 4: CÓMO BLINDAR AL CONSEJO (Y A TI MISMO) ANTE NIS2 Y DORA

- 4.1. Filosofía Zero Trust como doctrina jurídico-técnica

- 4.1.1. La integración de la firma electrónica cualificada en el flujo Zero Trust

- 4.1.2. El conflicto entre interoperabilidad y desconfianza

- 4.1.3. Análisis forense en entornos de confianza cero

- 4.1.4. Zero Trust como doctrina

- 4.2. Obligaciones NIS2 para administraciones públicas

- 4.2.1. Análisis de riesgos y seguridad de sistemas de información

- 4.2.2. Gestión de incidentes de ciberseguridad

- 4.2.3. Continuidad operativa y gestión de crisis

- 4.2.4. Seguridad de la cadena de suministro de tecnologías de la información y comunicación

- 4.2.5. Controles técnicos fundamentales de ciberseguridad

- 4.2.6. Gobernanza, supervisión directiva y formación en ciberseguridad

- 4.3. DORA. Resiliencia operativa digital en sector financiero y extensibilidad a administraciones públicas

- 4.3.1. DORA como laboratorio regulatorio de supervisión intensiva

- 4.3.2. Los cinco pilares arquitectónicos de resiliencia operativa bajo DORA

- 4.3.3. Extensibilidad de principios DORA a administraciones públicas

- 4.3.4. Aplicabilidad específica a entidades financieras públicas

- 4.4. Síntesis arquitectónica de blindaje institucional

- 4.4.1. Del cumplimiento fragmentado a la arquitectura integrada

- 4.4.2. Mapeo de convergencias normativas

- 4.4.3. Arquitectura técnica de referencia para blindaje institucional

- 4.4.4. Roadmap de implementación gradual

- 4.5. Arquitectura de blindaje institucional bajo NIS2/DORA/ENS

- 4.1. Filosofía Zero Trust como doctrina jurídico-técnica

- CAPÍTULO 5: LA GRADUACIÓN DE LA AUTONOMÍA

- 5.1. La automatización como desafío a la imputabilidad clásica

- 5.2. Taxonomía operativa de niveles de autonomía algorítmica

- 5.2.1. Nivel 0. Sin automatización

- 5.2.2. Nivel 1. Asistencia informacional

- 5.2.3. Nivel 2. Recomendación automatizada

- 5.2.4. Nivel 3. Automatización supervisada

- 5.2.5. Nivel 4. Automatización autónoma con aprendizaje continuo

- 5.2.6. Nivel 5. Autonomía general (AGI): prohibido

- 5.2.7. Tabla comparativa de los cinco niveles

- 5.2.8. Árbol de decisión para clasificación de sistemas

- 5.2.9. Casos frontera y resolución

- 5.2.10. Conclusión de Sección 5.2.

- 5.3. Régimen de responsabilidad administrativa por nivel de autonomía

- 5.3.1. Responsabilidad en Nivel 1. Asistencia informacional

- 5.3.2. Responsabilidad en Nivel 2. Recomendación automatizada

- 5.3.3. Responsabilidad en Nivel 3. Automatización supervisada

- 5.3.4. Responsabilidad en Nivel 4. Automatización autónoma con aprendizaje

- 5.3.5. Tabla de responsabilidad por nivel

- 5.3.6. Principios transversales de responsabilidad

- 5.3.7. Conclusión de Sección 5.3.

- 5.4. Validación de la taxonomía mediante casos ilustrativos

- 5.4.1. Caso 1: Sistema VioGén – Nivel 2 (Recomendación automatizada)

- 5.4.2. Caso 2: Sistema de asignación de plazas escolares – Nivel 3 (Automatización supervisada)

- 5.4.3. Conclusión de Sección 5.4.

- 5.5. Automatización algorítmica y principios constitucionales de buena administración

- 5.5.1. Tensión 1: Eficacia administrativa versus supervisión humana exhaustiva

- 5.5.2. Tensión 2: Imparcialidad y objetividad versus sesgos algorítmicos

- 5.5.3. Tensión 3: Seguridad jurídica versus aprendizaje continuo

- 5.5.4. Tensión 4: Tutela judicial efectiva versus opacidad algorítmica

- 5.5.5. Conclusión de sección 5.5.

- 5.6. Hacia una ley de transparencia algorítmica. La iconografía HMC como estándar de evidencia en el sector público español

- 5.6.1. Insuficiencia del marco actual. El vacío de comunicación al ciudadano

- 5.6.2. El sistema de iconografía HMC. Del estándar Dubai al derecho español

- 5.6.3. Propuesta de reforma legislativa. Nuevo artículo 41bis de la Ley 39/2015

- 5.6.4. Techos de automatización por tipo de trámite

- 5.6.5. Implementación y verificación. El rol de AESIA

- 5.6.6. Sinergia iconografía HMC y arquitectura X-FAIT

- CAPÍTULO 6: SOBERANÍA DIGITAL Y GOBERNANZA DE DATOS. EL PATRIMONIO DE LA ADMINISTRACIÓN EN LA ERA DE LA IA

- 6.1. La Reconceptualización de la Soberanía en el Espacio de Datos Europeo

- 6.2. Arquitecturas de Datos Soberanas. Del Cloud Centralizado al Edge Administrativo

- 6.2.1. Tipología de entornos de datos en la Administración

- 6.2.2. La nube pública global: eficiencia a costa de soberanía condicional

- 6.2.3. El cloud soberano europeo como compromiso estructural

- 6.2.4. El edge administrativo como garantía última de proximidad y control

- 6.2.5. Matriz comparativa: on-prem, nube global, cloud soberano y edge administrativo

- 6.3. Gobernanza de datos explotables por IA. Calidad, integridad y propiedad intelectual

- 6.3.1. Calidad de los datos: métricas operativas para IA pública

- 6.3.2. Integridad de datos: linaje y controles de transformación

- 6.3.3. Propiedad intelectual: el conocimiento institucional como activo crítico

- 6.4. El anclaje de supervivencia. Resiliencia de datos ante ataques de envenenamiento (Adversarial AI)

- 6.4.1. Taxonomía operativa de ataques adversariales a datos

- 6.4.2. Arquitectura del anclaje de supervivencia

- 6.5. Ética de los datos y el derecho a la explicabilidad

- 6.5.1. Explicabilidad técnica vs. explicabilidad jurídica

- 6.5.2. Protocolos de explicabilidad por diseño

- Key takeaways de la Parte III

- Glosario síntesis interseccional

- Transición a Parte IV

- CAPÍTULO 4: CÓMO BLINDAR AL CONSEJO (Y A TI MISMO) ANTE NIS2 Y DORA

- PARTE IV: GESTIÓN DE CIBERCRISIS, RESILIENCIA INSTITUCIONAL Y APRENDIZAJE POSFALLO

- CAPÍTULO 7: GESTIÓN DE CIBERCRISIS Y GOBERNANZA EN ESCENARIOS DE ALTA PRESIÓN

- PARTE A: ARQUITECTURA DE LA RESPUESTA INSTITUCIONAL

- 7.1. Crisis y Cibercrisis. Delimitación conceptual y consecuencias jurídicas

- 7.2. Modelos de Gestión Escalonada. Bronze, Silver y Gold

- 7.2.1. Nivel Bronze. Táctica de integridad y verdad forense

- 7.2.2. Nivel Silver. Coordinación de Riesgos de Compliance

- 7.2.3. Nivel Gold. Soberanía decisional y responsabilidad política

- 7.3. La dimensión humana. sesgos cognitivos y el control efectivo

- 7.4. Velocidad, automatización y el límite humano

- PARTE B: GOBERNANZA EN EL MOMENTO DE LA VERDAD

- 7.5. Cuando la seguridad falla. La auditoría de la soberanía

- 7.6. Supervisores, autoridades y el nuevo ecosistema de control

- 7.7. Comunicación en crisis. Entre la transparencia y el pánico

- 7.8. Errores fatales y crisis de legitimidad

- 7.9. Aprendizaje Institucional y Memoria del Error. La Inmunidad del Sistema

- Key takeaways de la Parte IV

- Glosario síntesis interseccional

- Transición a Parte V

- PARTE A: ARQUITECTURA DE LA RESPUESTA INSTITUCIONAL

- CAPÍTULO 7: GESTIÓN DE CIBERCRISIS Y GOBERNANZA EN ESCENARIOS DE ALTA PRESIÓN

- PARTE V: GOBERNANZA EN INCERTIDUMBRE PERMANENTE Y SOBERANÍA DEL MANDO ALGORÍTMICO

- CAPÍTULO 8: GOBERNAR LA CIBERSEGURIDAD EN 2026. LIDERAZGO, RIESGO Y ACCIÓN RESPONSABLE

- 8.1. Del control perimetral a la arquitectura del privilegio

- 8.1.1. Del gestor técnico al garante institucional

- 8.1.2. La traducción del riesgo técnico en valor estratégico

- 8.1.3. El CISO como facilitador de la responsabilidad directiva

- 8.1.4. La legitimidad como frontera final

- 8.2. Gestión del riesgo en entornos automatizados y algorítmicos

- 8.2.1. El desplazamiento hacia el riesgo algorítmico y de identidad

- 8.2.2. El riesgo de imputación y el marco regulatorio europeo

- 8.2.3. Del análisis estático al control continuo y gobernable

- 8.3. Gobernanza operativa de agentes de inteligencia artificial

- 8.3.1. La Identidad Artificial como anclaje de control y supervisión

- 8.3.2. Sincronía con el AI Act y el ENS. Evitar las islas de automatización

- 8.3.3. Contra la ilusión de control. Responsabilidad y resiliencia

- 8.4. Arquitecturas de identidad resilientes y el modelo Zero Trust

- 8.4.1. La identidad como frontera dinámica y especializada

- 8.4.2. Zero Trust. Verificación continua y control de contexto

- 8.4.3. Zero Trust como principio de desconfianza estructural

- 8.4.4. Identidad, contexto y control continuo

- 8.4.5. Resiliencia como capacidad de contención y cumplimiento

- 8.5. Resiliencia organizativa y toma de decisiones bajo presión

- 8.5.1. La resiliencia como capacidad de decisión, no solo de recuperación

- 8.5.2. El piloto automático institucional y la revocación del mandato

- 8.5.3. El CISO como intérprete de la agencia algorítmica

- 8.5.4. Coherencia, legitimidad y la arquitectura de la evidencia

- 8.6. Hoja de ruta para organizaciones públicas europeas

- 8.6.1. De la conformidad normativa a la capacidad institucional

- 8.6.2. Integración de la gobernanza de IA en el núcleo de la ciberseguridad

- 8.6.3. La identidad como infraestructura de fe pública

- 8.6.4. Liderazgo público y gestión del cambio

- 8.6.5. Una hoja de ruta evolutiva hacia la Arquitectura de la Evidencia

- 8.7. Gobernar la complejidad. Ciberseguridad, inteligencia artificial y legitimidad democrática

- 8.8. Epílogo. ¿Quién gobierna cuando gobiernan los sistemas?

- 8.1. Del control perimetral a la arquitectura del privilegio

- CAPÍTULO 9: EL FUTURO DE LA CIBERSEGURIDAD. GOBERNAR SISTEMAS QUE YA NO CONTROLAMOS DEL TODO

- 9.1. De la seguridad como función a la seguridad como sistema de gobierno

- 9.2. Europa ante el dilema de la automatización soberana

- 9.3. El nuevo contrato institucional. Ciudadanos, algoritmos y responsabilidad

- 9.4. El CISO y la alta dirección como arquitectos de confianza

- 9.5. Gobernar en incertidumbre permanente. El realismo estratégico de la ciberseguridad

- 9.6. Anclajes de supervivencia para una ciberseguridad legítima

- 9.6.1. Responsabilidad indelegable en la toma de decisiones digitales

- 9.6.2. La trazabilidad como presupuesto de explicabilidad y rendición de cuentas

- 9.6.3. El control humano significativo en los puntos de no retorno

- 9.6.4. La identidad gobernada como base de imputación jurídica

- 9.6.5. Transparencia operativa compatible con la seguridad

- 9.6.6. Capacidad institucional de aprendizaje tras el fallo

- Key takeaways de la Parte V

- Glosario síntesis interseccional

- CAPÍTULO 8: GOBERNAR LA CIBERSEGURIDAD EN 2026. LIDERAZGO, RIESGO Y ACCIÓN RESPONSABLE

- PARTE VI: ANEXOS

- 1. Doctrina

- 1.1. Glosario completo

- 1.2. Referencias bibliográficas

- TABLA DE ABREVIATURAS

- 1. Doctrina

- Ilustración 1. Flujo de responsabilidad NIS2.

- Ilustración 2. Para operar bajo el Reglamento, es vital entender que no todos los sistemas exigen la misma diligencia.

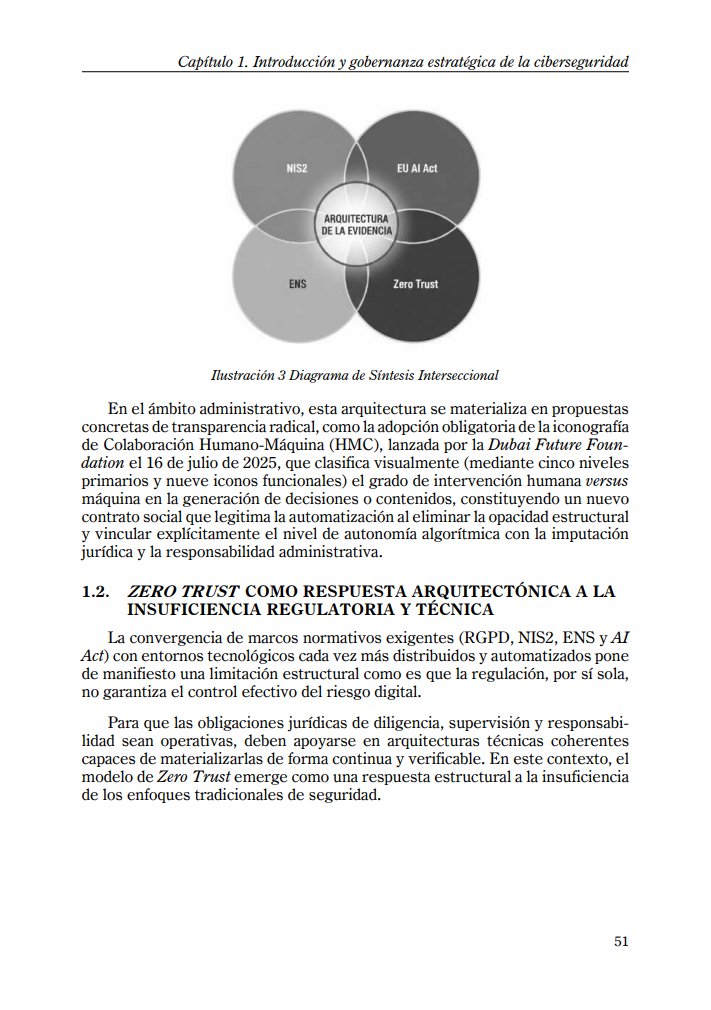

- Ilustración 3. Diagrama de Síntesis Interseccional.

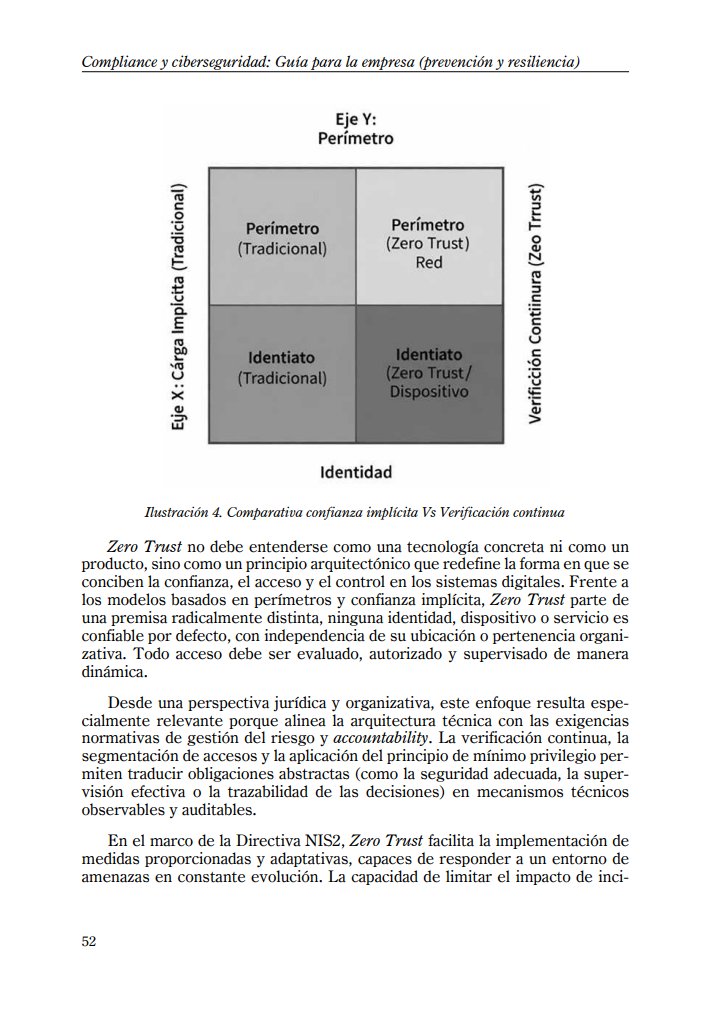

- Ilustración 4. Comparativa confianza implícita Vs Verificación continua.

- Ilustración 5. La ciberseguridad ya no es un silo técnico. El Radar de Convergencia ilustra cómo la responsabilidad directiva nace de la intersección inevitable de estas tres corrientes normativas.

- Ilustración 6. Modelo de Gobernanza de la IA en la Administración Pública.

- Tabla 1. Convergencia normativa NIS2, AI Act y ENS en la gobernanza de identidades artificiales.

- Tabla 2. Diagrama de flujo de imputación jurídico-técnica (X-FAIT).

- Tabla 3. Aceptación ciudadana de IA por tipo de decisión y nivel de autonomía.

- Tabla 4. Pipeline de procesamiento en las cinco fases.

- Tabla 5. Componente arquitectónico sin ZKP.

- Tabla 6. Componente arquitectónico con ZKP.

- Tabla 7. Sistema de inteligencia sin DP.

- Tabla 8. Sistema de inteligencia con DP.

- Tabla 9. Arquitectura Pai.

- Tabla 10. Flujo integrado end-to-end.

- Tabla 11. Flujo de datos en arquitectura tradicional.

- Tabla 12. Solicitud Inicial sin datos sensibles.

- Tabla 13. Orquestación con ZKP.

- Tabla 14. Sellado en blockchain.

- Tabla 15. Notificación y estadísticas con DP.

- Tabla 16. Arquitectura de interpretabilidad estratificada.

- Tabla 17. Normativa. Distribución de responsabilidades.

- Tabla 18. Gestión de incidentes de ciberseguridad. Distribución de responsabilidades.

- Tabla 19. Continuidad operativa y gestión de crisis. Distribución de responsabilidades.

- Tabla 20. Seguridad de la cadena de suministro de tecnologías de la información y comunicación. Distribución de responsabilidades.

- Tabla 21. Controles técnicos fundamentales de ciberseguridad. Distribución de responsabilidades.

- Tabla 22. Gobernanza, supervisión directiva y formación en ciberseguridad. Distribución de responsabilidades.

- Tabla 23. Evidencia de cumplimiento. Distribución de responsabilidades.

- Tabla 24. Dimensión. Controles técnicos fundamentales.

- Tabla 25. Dimensión 2. Procesos organizativos críticos.

- Tabla 26. Dimensión 3. Gobernanza y supervisión directiva.

- Tabla 27. Dimensión 4. Arquitectura ZTA como doctrina.

- Tabla 28. Dimensión 5. Plazos y umbrales críticos.

- Tabla 29. Dimensión 6. Convergencias y divergencias normativas.

- Tabla 30. Tabla de los cinco niveles.

- Tabla 31. Árbol de decisión para clasificación de sistemas.

- Tabla 32. Responsabilidad por nivel.

- Tabla 33. Diferencias operativas por niveles de autonomía.

- Tabla 34. Tabla de tensiones y principios de resolución.

- Tabla 35. Niveles HMC.

- Tabla 36. Arquitectura de techos de automatización por tipo de trámite.

- Tabla 37. Actuaciones administrativas automatizadas (Ley 39/2015) con el modelo propuesto de iconografía HMC.

- Tabla 38. Matriz comparativa on-prem, nube global, cloud soberano y edge administrativo.

- Tabla 39. Taxonomía operativa de ataques a datos.

- Tabla 40. Ética de los datos y el derecho a la explicabilidad.

- Tabla 41. Matriz de niveles de respuesta y atribución de responsabilidad dual.

- Tabla 42. Europa ante el dilema de la automatización soberana.

- Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (I).

- Tabla 44. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (II).

- Tabla 45. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (III).

- Tabla 46. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (IV).

- Tabla 47. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (V).

- Tabla 48. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (VI).

- Tabla 49. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (VII).

- Tabla 50. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (VIII).

- Tabla 51. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (IX).

- Tabla 52. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (X).

- Tabla 53. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (XI).

- Tabla 54. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (XII).

- Tabla 55. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (XIII).

- Tabla 56. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (XIV).

- Tabla 57. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (XV).

- Tabla 58. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (XVI).

- Tabla 59. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (XVII).

- Tabla 60. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (XVIII).

- Tabla 61. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (XIX).

- Tabla 62. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (XX).

- Tabla 63. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (XXI).

- Tabla 64. Tabla 43. Intersección: Derecho Administrativo + Ciberseguridad + Gobernanza Algorítmica (XXII).

- Tabla 65. Administraciones y autoridades.

- Tabla 66. Marcos normativos europeos.

- Tabla 67. Marcos normativos nacionales.

- Tabla 68. Roles y funciones organizativos.

- Tabla 69. Arquitecturas y frameworks técnicos.

- Tabla 70. Componentes de identidad y criptografía.

- Tabla 71. Amenazas y respuesta a incidentes.

- Tabla 72. Evaluaciones y compliance.

- Tabla 73. Conceptos originales de esta investigación.

- Tabla 74. Inteligencia artificial y Machine Learning.

- Tabla 75. Resiliencia y continuidad operativa.

- Tabla 76. Estándares y metodologías internacionales.

- Tabla 77. Tecnologías emergentes.

FASE 2